联邦学习(Federated Learning)

I. 联邦学习简介

联邦学习(Federated Learning)是近年来兴起的一种加密的分布式机器学习新范式,可以让各参与方在数据不出本地的情况下进行AI协作,实现“知识共享而数据不共享”,提升各自的AI模型效果,是破解现阶段AI行业落地中的“数据孤岛”与“数据隐私保护”两大“卡脖子”难题最行之有效的解决方案。

联邦学习在 2016 年由谷歌最先提出,原本用于解决安卓手机终端用户在本地更新模型的问题,其设计目标是在保障大数据交换时的信息安全、保护终端数据和个人数据隐私、保证合法合规的前提下,在多参与方或多计算结点之间开展高效率的机器学习。

2018年12月IEEE标准委员会(SASB)批准了由微众银行发起的关于《联邦学习架构和应用规范》的标准立项。2021年3月,联邦学习标准正式发布,形成正式标准文件(IEEE P3652.1)。这是国际上首个针对人工智能协同技术框架订立的标准。

国内首个联邦学习团体标准(AIOSS)已于2019年6月发布。目前在联合多家单位积极推动将联邦学习纳入国家标准。

联邦学习的分类

联邦学习涉及两个不同的概念:

第一种是谷歌提出的联邦学习,旨在解决云 + 端训练过程中,端上隐私不暴露的问题,这是一个 To C + 数据水平切分的场景。除了保护端上的数据隐私外,其重点还在于如何解决训练过程中,端自身可能掉线等问题。

第二种是国内提出的联邦学习,主要用于解决 To B 场景中各方隐私不泄露的问题,既可应用于数据的水平切分场景,也可应用于数据垂直切分的场景。它们侧重于不同的数据共享场景,技术上有不同的侧重点。

上述两种联邦学习的概念主要是由于数据维度不同。根据数据维度不同,联邦学习分为纵向联邦学习、横向联邦学习、联邦迁移学习三种。

1.1横向联邦学习

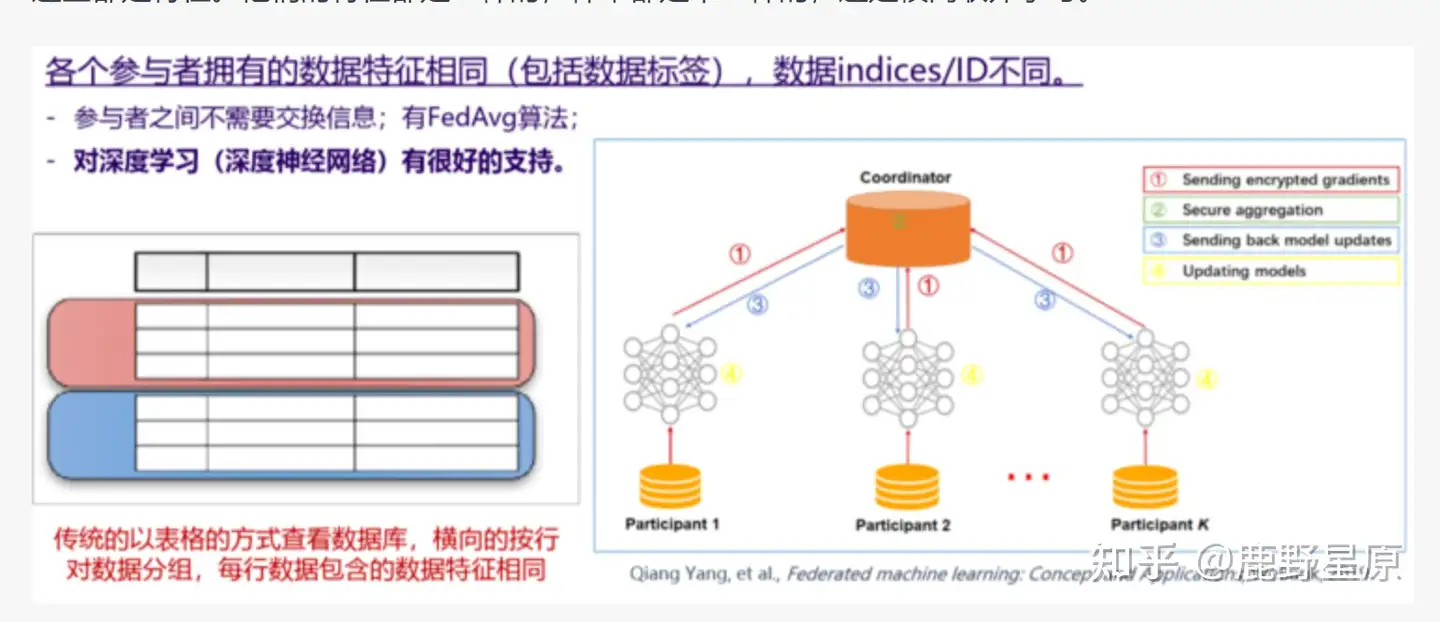

横向联邦学习在两个数据集的用户特征重叠较多,而用户重叠较少的情况下,把数据集按照横向(即用户维度)切分,并取出双方用户特征相同而用户不完全相同的那部分数据进行训练。

比如有两家不同地区的银行,它们的用户群体分别来自各自所在的地区,相互的交集很小。但是,它们的业务很相似,因此,记录的用户特征是相同的。此时,我们就可以使用横向联邦学习来构建联合模型。

谷歌在2016年提出了一个针对安卓手机模型更新的数据联合建模方案:在单个用户使用安卓手机时,不断在本地更新模型参数并将参数上传到安卓云上,从而使特征维度相同的各数据拥有方建立联合模型。

1.2 纵向联邦学习

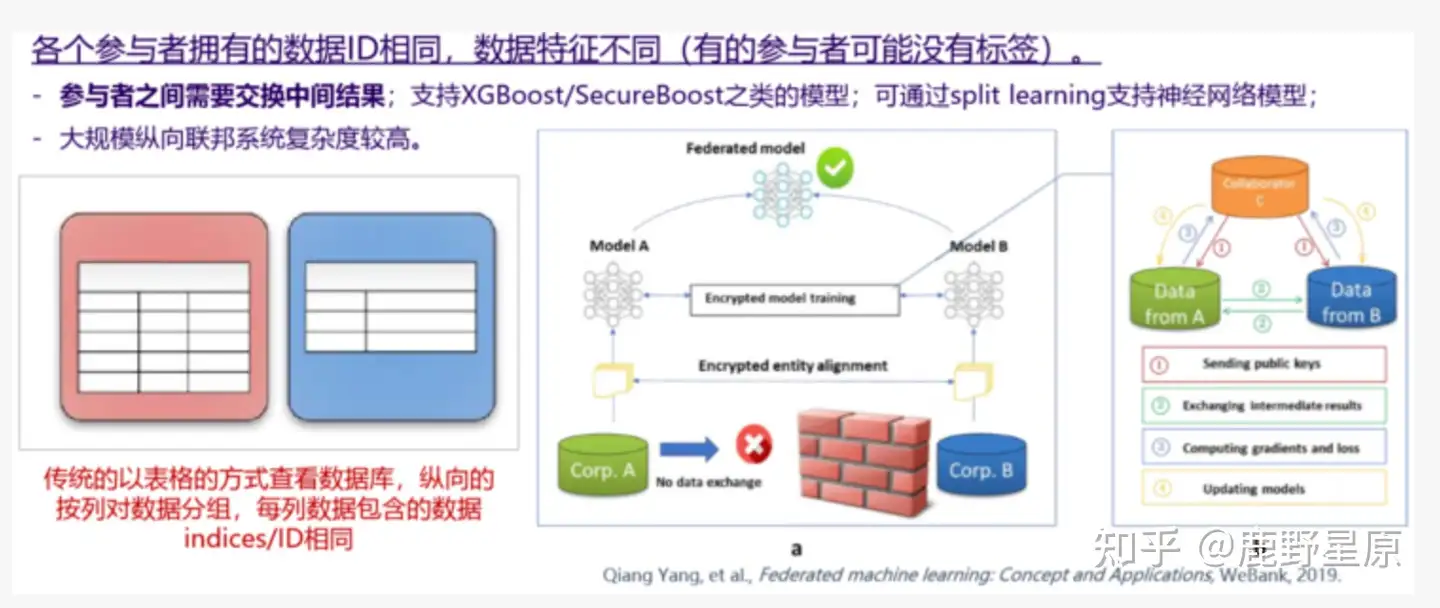

纵向联邦学习在两个数据集的用户重叠较多而用户特征重叠较少的情况下,把数据集按照纵向(即特征维度)切分,并取出双方用户相同而用户特征不完全相同的那部分数据进行训练。

比如有两个不同的机构,家是某地的银行,另一家是同一个地方的电商。它们的用户群体很有可能包含该地的大部分居民因此用户的交集较大。但是,由于银行记录的都是用户的收支行为与信用评级,而电商则保有用户的浏览与购买历史,因此它们的用户特征交集较小。纵向联邦学习就是将这些不同特征在加密的状态下加以聚合,以增强模型能力。

目前,逻辑回归模型、树形结构模型和神经网络模型等众多机器学习模型已经逐渐被证实能够建立在此联邦体系上。

1.3 迁移联邦学习

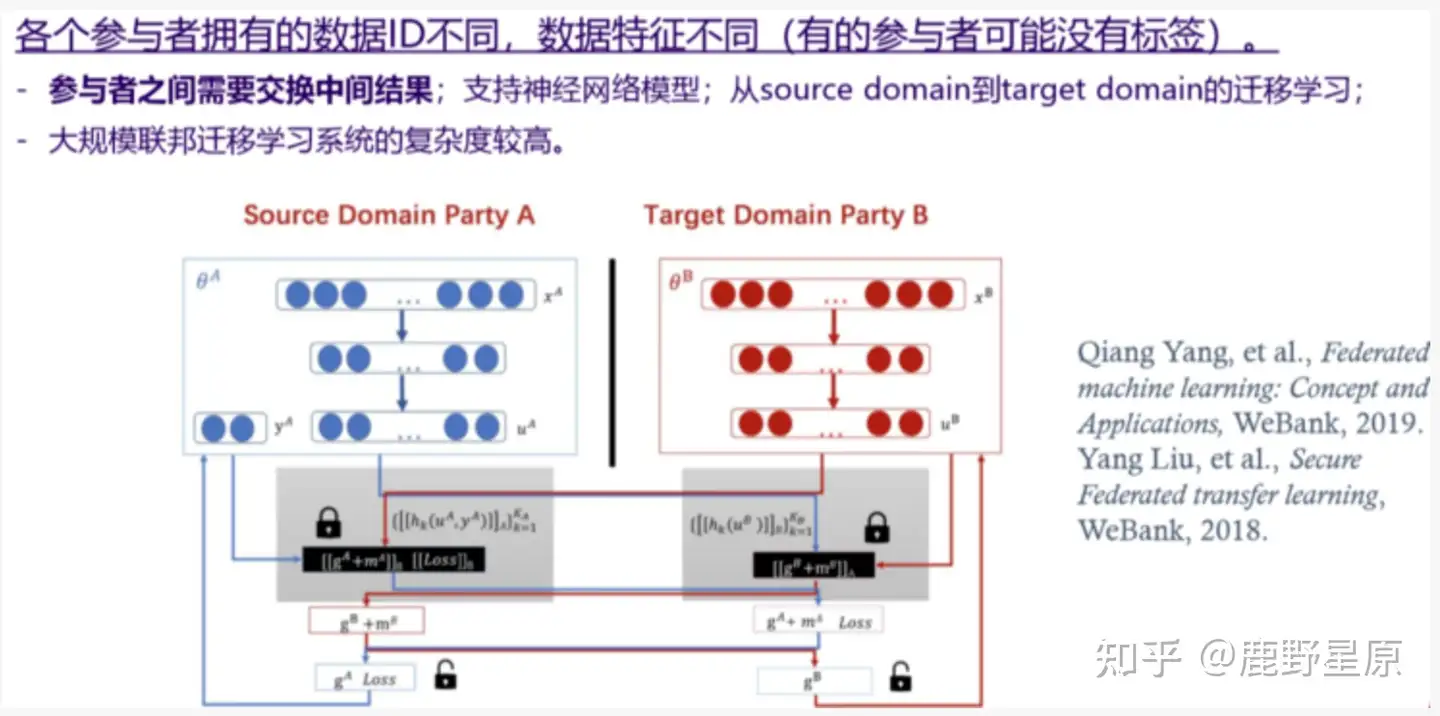

联邦迁移学习在两个数据集的用户与用户特征重叠都较少的情况下,不对数据进行切分,而利用迁移学习国来克服数据或标签不足的情况。

比如有两个不同机构,一家是位于中国的银行,另一家是位于美国的电商。由于受地域限制,这两家机构的用户群体交集很小。同时,由于机构类型的不同,二者的数据特征也只有小部分重合。在这种情况下,要想进行有效的联邦学习,就必须引入迁移学习,来解决单边数据规模小和标签样本少的问题,从而提升模型的效果。

2. 联邦学习的价值

2.1 联邦学习的技术贡献

当前,业界解决隐私泄露和数据滥用的数据共享技术路线主要有两条:

一条是基于硬件可信执行环境技术的可信计算:集中式,借助硬件,以蚂蚁金服为代表,底层使用Intel的SGX技术,试图打造出以阿里云为中心的商业模式。

另一条就是基于密码学的同态加密和多方安全计算:分布式,借助密码学算法,基于密码学的同态加密和多方安全计算(MPC:Multi-party Computation)。

第二条路线,即基于密码学的同态加密和多方安全计算(MPC)之前一直是学术界比较火的话题,但在工业界的存在感较弱,直到“联邦学习” 概念的出现,才使得MPC技术一夜之间在工业界火了起来。

通过数据不动模型动的方式,联邦学习技术能使数据可用不可见,有效保护数据安全与用户隐私。

作为一种新的学习范式,联邦学习具有以下特点:

在联邦学习的框架下,各参与者地位对等,能够实现公平合作;

数据保留在本地,避免数据泄露,满足用户隐私保护和数据安全的需求;

能够保证参与各方在保持独立性的情况下,进行信息与模型参数的加密交换,并同时获得成长;

建模效果与传统深度学习算法建模效果相差不大;

联邦学习是一个「闭环」的学习机制,模型效果取决于数据提供方的贡献。

2.2 联邦学习的公共价值

加速人工智能创新发展

作为AI建模底层核心技术,联邦学习将真正助力大数据实现价值。在数据不出本地的环境下带动AI各领域在各行业的深度融合。

保障隐私安全和数据安全

联邦学习可以做到个体的自有数据不出本地,联邦系统通过加密机制下的参数交换方式,在不违反隐私法规的情况下,建立一个虚拟的共有模型。建立虚拟模型时,数据本身不移动,也不会泄露用户隐私或影响数据规范,充分保障了个体隐私信息及数据安全。

促进全社会智能化水平提升

基于联邦学习的AI技术将更安全地融入社会基础设施和生活中,它不仅辅助人类的工作及生活,也逐步改变人类认知模式,从而推动社会经济发展。

2.3 联邦学习的商业价值

带动跨领域的企业级数据合作

作为AI底层技术,帮助企业参与到新的全球化、泛行业化的协作网络和联邦生态中,通过跨领域的企业界数据合作,更有效地训练模型辅助自身市场布局、策略优化,从而提升竞争力。联邦学习能在技术层面帮助企业更好地确立自身合作和竞争策略,从而推动企业良性发展。

催生基于联合建模的新业态和模式

通过联邦学习在其他领域的应用拓展,将不断影响和改变合作中提供方、需求方的关系,重新定义合作者的身份、服务方式和盈利方式,催生出基于联合建模的全新业态。

降低技术提升成本和促进创新发展

联邦学习技术成体系可复用的解决方案能够有效降低技术应用的门槛,扩大技术应用的范围和广度,为不同用户提供更丰富的产品和服务,同时去除数据安全隐忧的AI大环境将有助于创新型技术进一步飞跃,在提升效率获得成长的同时,实现自身发展。

3. 联邦学习的应用

3.1 医疗

医疗联邦学习框架

腾讯天衍实验室通过联合微众银行,研发了医疗联邦学习框架,也是联邦学习在医疗健康大数据领域应用的首个成功案例。

双方首先通过搭建的大数据集中与挖掘平台,构建医疗健康领域多种大数据模型,对地区居民连续电子病历和其它数据进行多重关联和信息抽取。构建带有时间标志的重大慢病标签与大健康医疗特征,并对不同医院构建统一的数据标准形成疾病标签集与特征集。

通过技术力量对疾病预测模型所需特征进行标准与归一化后,再将标准化模型部署到不同医院,使各医院按照该标准形成各自的标准化的疾病标签集与医疗特征集,再以此建立巢式病例对照研究队列,基于联邦学习算法协议,有效训练机器学习模型。

通过使用来自就诊记录数量TOP5的医院真实就诊数据验证,基于横向联邦学习的脑卒中预测模型的有效性良好。联邦学习模型和集中训练模型表现几乎一致,在脑卒中预测模型中的准确率达到80%。

生命大数据可信计算平台

2020年10月,国家基因库生命大数据平台(CNGBdb)重磅发布生命大数据可信计算平台CODEPLOT:一个集可信计算环境和多元化在线分析工具于一体的生命大数据分析平台,也是国内率先将联邦学习、数据加密、区块链、安全多方计算、基因安全容器虚拟化等最新安全策略应用于生命大数据分析利用和合作共享的平台。

该平台以数据汇交模块存储的海量数据为支撑,以灵活工作空间管理模式为核心,同时提供多元化分析工具,全面打通各科研机构之间的数据孤岛,突破数据分析门槛,提升数据利用率,促进重大科研项目合作共享及成果转化。

3.2 金融

微众银行的FATE应用于小微企业信贷风险管理

微众银行与江苏银行联合共建“智能化信用卡管理联合实验室”,围绕联邦学习开展深入合作,推动AI技术与信贷风控结合,开启信用卡智能化经营之路。

协助济宁银行建设线上信贷业务系统,通过联邦学习技术在“数据不出域”的前提下联合构建反欺诈模型、画像模型,模型效果显著提升。在丰富银行的大数据信贷风控能力同时实现优质客群优质定价,既满足了银行实际管理需求,资金又得到高效使用。

FATE应用于构建联邦反洗钱模型

借助FATE,微众银行联合多家银行,联合训练反洗钱模型。

联合训练的模型称为 Homogeneous Logistic Regression (Homo-LR)。所有银行都提供同质类型的数据,这意味着它们具有相同的特征和不同的样本 ID。通过这种组合,整个数据集包含了大量的正面案例,使模型表现良好。这次合作取得了巨大的成功,显着提高了模型的性能大幅降低了人工审核的数量和难度。

京东城市的联邦数字网关构建信用评分模型

在信用场景中,通过联邦数字网关产品, 使用多方数据,构建信用评分卡模型,利用信用评分模型可对企业或个人信用信息进行量化分析,从而降低信用在行政领域、社会领域、金融等领域的应用风险,发挥信用在优化营商环境、强化惠民便企服务的作用。

3.3 智慧城市

京东城市联邦数字网关用于智能选址

从2018年起,先后在包括雄安信息块数据平台、联通营业厅智能选址、南通雪亮工程等9个政府、企业项目中部署落地。

在新基建类的南通项目中,联邦数字网关通过对多方人群流量数据进行跨域融合计算,对区域人口指标进行修正,辅助城市监测预警、地块选址、经济分析等多个应用场景,具有很高的复制性和推广性。

在智慧选址项目中,使用多方数据分析地块特征,不仅帮助有零售业态的企业选址,还提供人流的监测,辅助门店运营,配合用户的引流,全方位的支持零售业态。同时,选址是低频行为,智能选址能满足机构之间在数据、模式、触达用户渠道等多方面互补作用。

3.4 AI训练

Hey google的改进

谷歌使用联邦学习来改进“Hey Google”模型并尝试减少错误激活和遗漏。

具体而言,谷歌助理使用存储在用户设备上的录音来改进“Hey Google”模型,学习如何从语音数据中调整模型,并将模型更改的摘要发送到 Google 服务器,以便为每个用户提供更好的模型。

II. 互联网公司的联邦学习相关情况

1. Google

率先提出了 Federated Learning(联邦学习)的概念

2016 年,谷歌就在论文 《Federated Learning: Strategies for Improving Communication Efficiency》 中率先提出了 Federated Learning(联邦学习)的概念,主要用来解决联合存在于多个终端(例如移动手机)中的数据进行中心化模型训练的问题,并应用在输入法改进等场景。

TensorFlow Federated (TFF)

TensorFlow Federated是一个开源框架,用于在去中心化数据上试验机器学习和其他计算。借助 TFF,可以将一个灵活、开放的框架用于本地模拟分散式计算,让所有 TensorFlow 用户都可以使用。它助力于联邦学习的实现,使许多参与者能够训练共享的 ML 模型,同时将其数据保存在本地。但目前仅支持横向联邦学习。

Gboard

谷歌目前正在Android上的Gboard 中测试联合学习,即 Google 键盘。当 Gboard 显示建议查询时,用户手机会在本地存储有关上下文以及用户是否点击了建议的信息。联合学习处理设备上的历史记录,以提出对 Gboard 查询建议模型的下一次迭代的改进建议。

Google Assistant

Google Assistant使用存储在用户设备上的录音来改进“嘿谷歌”检测等模型。它学习如何从语音数据中调整模型,并将模型更改的摘要发送到 Google 服务器,以便为每个人提供更好的模型。仅当设备处于空闲状态、插入电源并连接到 Wi-Fi 时, Google Assistant才会在用户设备上执行联合学习计算。

2. 腾讯

IEEE P3652.1

微众银行是IEEE P3652.1标准的牵头者以及组织成员

PaaS级和SaaS级

腾讯是国内最早倡导“联邦学习”的企业之一,其联邦学习技术已覆盖PaaS级和SaaS级领域,形成产业链协同互补关系。

在PaaS级层面,腾讯微众银行(WeBank)提出了工业级别联邦学习框架——联邦学习开源项目Federated AI Technology Enabler(简称 FATE);腾讯TEG数据平台部基于自研分布式机器学习平台Angel,设计了一种“去中心化”的联邦学习框架PowerFL,并研发了FM、神经网络等联邦学习算法。腾讯安全对这两种计算框架进行了云化部署,形成了PaaS级联邦学习服务。

在SaaS级层面,腾讯安全联邦学习应用服务基于自身海量安全大数据,提供安全、合规、高效的联合建模服务,并通过部署在云端的SaaS服务进行输出,帮助企业机构用户快速应用联邦学习技术成果;同时支持海量互联网用户参与对用户有价值的联合建模,在个人隐私数据均不出个人终端设备的情况下实现有价值的数据应用。

联邦学习框架FATE

微众银行在2019年2月开源了联邦学习框架FATE,这也是全球首个工业级联邦学习开源框架。之所以称FATE为「工业级」,在于它能够解决包括计算架构可并行、信息交互可审计、接口清晰可扩展在内的三个工业应用常见问题。

FATE项目不仅提供了20多个联邦学习算法组件、比如 LR、GBDT、CNN 等,覆盖常规商业应用场景的建模需求,还特别提供了一站式联邦模型服务解决方案,涵盖联邦特征工程、模型评估、在线推理等。更重要的是,它给开发者提供了实现联邦学习算法和系统的范本,大部分传统算法都可以经过一定改造适配到联邦学习框架中来。

微众也与VMWare深度合作、深度绑定,推出了KubeFATE系统,帮助用户更好地在Cloud上面进行应用。目前这一开源框架已在信贷风控、客户权益定价、监管科技等领域推动应用落地。

腾讯安全联邦学习应用服务

腾讯安全联邦学习应用服务通过低成本快速迭代的联合建模服务,能够在保护所有参与方隐私的同时,有效释放出各方大数据生产力,广泛适用于业务创新的应用场景。根据具体应用场景下数据的组织和使用形式不同,腾讯安全联邦学习应用服务技术分为“纵向”和“横向”两种。

纵向联邦学习应用服务

主要针对拥有异构数据的机构,如银行、电商等,通过融合多个机构对相同样本的不同观察进行AI联合建模。目前聚焦银行、消金、互金等金融机构的信贷审批难题,提供安全、合规、高效的联合建模服务,下一步会延展到其他行业业务创新服务。

横向联邦学习应用服务

主要针对拥有同构数据的大量终端用户,如互联网APP用户,通过融合终端用户对相同设备或应用的不同体验进行AI联合建模。在经用户授权后,联合建模过程中,用户的个人隐私均不出个人终端设备(如:手机、平板),从而保证了个人隐私安全。腾讯安全支持海量互联网用户参与对用户有价值的联合建模,基于腾讯安全自研的可实际部署在移动设备(如:安卓手机、平板、IoT设备等)上商用的“端-云”横向联邦学习应用服务框架,提供对用户有价值的应用服务。

服务案例:

江苏银行:双方联合共建“智能化信用卡管理联合实验室”,围绕联邦学习开展深入合作,推动AI技术与信贷风控结合,开启信用卡智能化经营之路。

济宁银行:协助建设线上信贷业务系统,通过联邦学习技术在“数据不出域”的前提下联合构建反欺诈模型、画像模型,模型效果显著提升。在丰富银行的大数据信贷风控能力同时实现优质客群优质定价,既满足了银行实际管理需求,资金又得到高效使用。

四川航空:通过“联邦学习”为四川航空打造出全票务智能营销风控中台。在用户信息不出域的条件下,腾讯安全与四川航空实现模型差异梯度交换,完成黑产欺诈模型联合建模。建模后的票务欺诈模型有较好的欺诈识别效果,已经在四川航空的APP、官网订票渠道中上线。

个人相册类APP厂商:基于腾讯安全的“端-云”横向联邦学习应用服务框架,业务APP可以在终端设备上根据用户的行为(如:停留在每张照片上的时间、操作等)对用户照片的喜好进行本地建模;通过将生成的不泄露用户隐私的中间结果进行加密传输,并在腾讯安全联邦学习后台安全聚合为统一模型,从而实现在不触及用户隐私的前提下对用户个性化喜好进行建模,模型准确率提升了约10%。

腾讯云联邦学习产品

腾讯云联邦学习通过低成本快速迭代的联合建模服务,充分释放大数据的生产力。

广泛适用于各种业务创新场景:

银行业:银行风控场景。银行零售信贷、信用卡等个金业务的贷前审批和贷中风控场景。

消金行业和持牌机构:消费金融公司、持牌互金平台个人信贷业务的贷前审批和贷中风控场景。

消费互联网行业:以智能终端(如安卓手机、平板、IoT 设备)为计算节点的,保护用户隐私信息为目的的各种场景。

AngelFL联邦学习平台

AngelFL联邦学习的发展,主要来自业务需求的驱动。整个平台构建在Angel智能学习平台的基础之上。Angel 已应用于微信支付、QQ、腾讯视频、腾讯社交广告及用户画像挖掘等业务,随着广泛的应用,在保护数据隐私的前提下,联合多方数据建模的需求日益凸显。基于对业务和现有技术方案的调研,团队重新设计了一种“去中心化”的联邦学习框架,无需依赖可信第三方。整个系统以 Angel 的高维稀疏训练平台作为底层,抽象出“算法协议”层,供实现各种常见机器学习算法。

技术优化在以下方面:

“去中心化” - AngelFL联邦学习系统主要采用了密码学中的同态加密算法,该加密算法有一个特点是:对经过同态加密后的密文数据进行运算,将运算结果解密,与未加密的原始明文数据进行同样运算的结果是一样的。利用这种特点,研发团队对需要双方交互的模型相关数据采用同态加密,直接发送给对方,对方在密文上完成训练所需的计算,然后将结果返回,接收方解密后,能得到计算后的结果,而无法获知其原始数据。

消息通信膨胀 - 这个问题也与同态加密有关。采用高强度加密算法,例如如果采用 2048 位 Paillier 加密,一个浮点数的体积将膨胀到 4096 位。研发团队采用 bit-packing 的方法压缩了密文的体积,从而较少网络传输量。

跨网传输消息拥塞 - 算法在训练过程中通常有大量的数据需要交换,这导致网络传输量巨大,而联邦的双方一般处于不同网络域中,如果采用简单的 RPC 点对点通信,容易引起交换机 in-cast 现象而导致消息拥塞。为了解决这一问题,研发团队采用 MessageQueue 作为消息管道,控制拥塞并提供消息持久化功能,增强系统稳定性。

加密解密加速 - 联邦学习涉及大量的数字加密和解密操作,属于计算密集型任务,可以采用硬件如 GPU 加速来解决,这方面研发团队正在探索中。

应用落地:

在公司内部,AngelFL联邦学习已经在金融云、广告联合建模等业务中开始落地,并取得初步的效果。以技术赋能的方式,为分布在不同部门和团队的数据搭建互通的桥梁,在保护数据隐私的前提下,使数据合力成为可能。

3. 华为

IEEE P3652.1

华为是IEEE P3652.1标准组织成员

研发团队

华为有两个不同的工作组进行To C、ToB的布局。

研究成果入选AAAI 2021

华为云 AI 最新联邦学习成果《Personalized Cross-Silo Federated Learning on Non-IID Data》成功入选人工智能顶级会议 AAAI 2021,揭秘个性化联邦学习框架。

论文地址:https://arxiv.org/abs/2007.03797

NAIE联邦学习部署服务

华为NAIE联邦学习平台提供了一键式创建联邦学习实例,用户只要下载一个客户端就可以轻松加入退出联邦学习,平台对联邦学习的整个过程达到了可视化的管理。

联邦学习中的角色包括联邦节点(中心服务器/Server)和边缘节点(联邦用户/Client)。用户的一些idea可以通过创建联邦实例来发起众筹式训练,其他用户只要下载一个客户端即可轻松加入训练,并能够查看训练状态,享受共同训练的成果。华为NAIE联邦学习平台具有联邦实例管理能力,边缘节点管理能力和运行联邦实例能力。

华为云可信智能计算服务

华为云可信智能计算服务( TICS,Trusted Intelligent Computing Service )面向政企行业,打破跨机构的数据孤岛,在数据隐私保护下实现多方数据联合分析和联邦学习。基于可信执行环境TEE、安全多方计算MPC、区块链等技术,实现数据在流通、计算过程中端到端的安全和可审计,推动跨机构数据的可信融合和协同,安全释放数据价值。

可运用于政府数据共治、金融联合营销、政企联合风控、使能数据交易等场景。

ModelArts 3.0

ModelArts是华为2018年发布的一站式AI开发平台,一直秉持“让AI开发用得好”的服务理念。如今ModelArts 3.0核心技术全线升级,意味着华为云将进一步降低AI开发门槛,加速在行业应用中的落地。

ModelArts 3.0有四大核心“黑科技”:

一是华为云骨干模型EI-Backbone,通过整合模型高效、数据高效、算力高效、知识高效,能够全面提升行业AI落地能力和体验;

二是支持联邦学习,实现数据不出户的联合建模,再配合上华为云普惠AI“用得好、用得起、用得放心”的方针,华为云EI出色地化解了传统联邦学习中成本高、对数据设备算力要求高、数据隐私容易被跟踪等问题;

三是提供全面的可视化评估以及智能诊断功能,使得开发者可以直观了解模型各方面性能,进而进行针对性的调优;

四是在集群规模、任务数量,以及分布式训练各个环节都做了针对性的优化,并且支持弹性训练,可以根据模型训练速度的需求自适应实现资源的最佳分配。

4. 字节

开源平台Fedlearner

2020年初,字节跳动开源了自研的联邦学习平台 Fedlearner(项目地址:https://github.com/bytedance/fedlearner),并持续更新,目前已更新至v1.5版本。 2021年3月,中国信息通信研究院(以下简称“中国信通院”)公布了安全评估结果,字节跳动Fedlearner联邦学习平台(以下简称“字节跳动Fedlearner”)成为顺利通过首批评估的平台之一。

Fedlearner已经在电商、教育、金融等行业多个落地场景实际应用,与行业头部客户合作进行技术沉淀及商业收益的验证, 为客户取得了切实的商业收益,提高了字节广告平台的整体竞争力。 在电商广告场景的落地案例中,Fedlearner 已经帮助合作方取得了 10% 以上的投放效率增长,跑量消耗提升 15%+,电商平台 ROI 提升 20%+。 除了电商行业,在与教育行业头部客户共同探索联邦学习落地的过程中,效果也得到了比较好的印证,帮助教育客户广告跑量提升 124.73%,正价课续报人数提升 211.54%,续报率提升 32.69%,正价课续费用户获客成本降低 11.73%。 在某金融行业头部客户的合作过程中,取得了客群平均风险大幅度降低的收益,在逾期风险不变的情况下,授信通过率提高10%。

学术成果

在学术上,因提出智能扰动方法,字节跳动关于联邦学习隐私保护的两篇研究论文,先后被第34届NeurIPS 2020 的联邦学习 Workshop 、ICML 2021的联邦学习 Workshop接收,论文作者也获邀于线上分享。

5. 阿里

IEEE P3652.1

阿里是IEEE P3652.1标准的组织成员

蚂蚁金服与共享智能

为了机构与自身信息协同等业务问题,蚂蚁金服从2016年开始投入到共享智能的研究中。

对于共享智能与联邦学习的差异,蚂蚁金服集团共享智能部总经理周俊指出:

联邦学习的架构是由一台中心服务器和多个计算节点构成,中心服务器会参与到整个计算过程,因此不适用于一些不需要中心服务器节点的应用场景。联邦学习要求原始数据不能出域,这也限制了其可以使用的技术方案;

而共享智能是从问题出发,解决方案中不仅包含有类似联邦学习的有中心服务器参与计算的模式,也包含完全去中心化的方案,还有基于TEE的共享学习方案。

共享智能联盟标准

2020年3月,由蚂蚁金服牵头制定的共享智能联盟标准,即《共享学习系统技术要求》,在AIIA联盟(中国人工智能产业发展联盟)正式发布。

该标准由蚂蚁金服与中国联通、中国信通院、中国电信、阿里巴巴集团、北京大学、中和农信、百度以及云从科技共同制定。

在国际标准方面上,蚂蚁金服已在HOE、ITOT进行标准的建立;在国内的CCSA(中国通信标准化协会)进行了标准的立项;在AIOSS(中国人工智能开源软件发展联盟)的标准已进入报批稿阶段。

阿里云机器学习平台PAI

2021 年 6 月 24 日中国信通院 “2021大数据产业峰会成果发布会”上,阿里云机器学习平台PAI获得“大数据产品能力评测”联邦学习项目基础能力专项评测证书。

PAI平台面向企业客户及开发者,提供轻量化、高性价比的云原生机器学习平台,提供从数据标注、数据预处理、特征工程、模型训练、自动调参数、模型优化到模型在线、离线推理服务的全流程支撑,支持千亿特征、万亿样本规模加速训练,预制多个行业典型场景算法组件,全面提升机器学习工程效率。

6. 京东

IEEE P3652.1

京东城市是IEEE P3652.1标准组的成员

技术产出情况

京东智能城市已经在世界期刊和会议上发表了50余篇论文,申请了100余项发明专利,主办和承办多个学术活动。

联邦数字网关

京东城市自主研发的联邦数字网关产品针对数据孤岛、数据接入难等痛点,基于联邦学习等技术,实现数据共享在深度、广度、智能三个维度的升级,实现政府、企业数据的价值挖掘,释放数据效能。

已拿到飞腾、龙芯、兆芯、申威、海光、鲲鹏等全部六大主流国产信创芯片版操作系统的兼容认证,成为智慧城市安全数据共享领域获得全面信创适配认证的产品。

目前已在信用、智能选址、精准营销、商圈洞察、市域治理现代化、企业帮扶、智慧城市等领域有一系列落地应用。

9N-FL 平台

在 2019 年 11 月份进行的开发,2020 上半年进行了正式的上线,并且在 2020 年 9 月份完成了正式的对外开源。项目背景是对其他公司的不具有原始数据的陌生用户精准投放广告。

自上线以来,九数联邦学习平台(9N-FL)在取得了较好业务成绩的同时,也经受住了业务大数据、大算力的考验。在与媒体进行京东广告投放业务场景中,基于媒体侧大量的数据(例如,媒体兴趣标签)、京东侧大量的用户商业兴趣及商品标签数据,双方使用联邦学习平台联合建模,来优化广告的触发召回、CTR/CVR 模型等多个模块,最终成功上线,取得了大概 15% 的收入提升。

7. 百度

IEEE P3652.1

百度是IEEE P3652.1标准组的成员

PaddleFL平台

2019年11月,百度宣布开源其联邦学习框架PaddleFL。

III. 联邦学习专利相关情况

市场专利持有情况

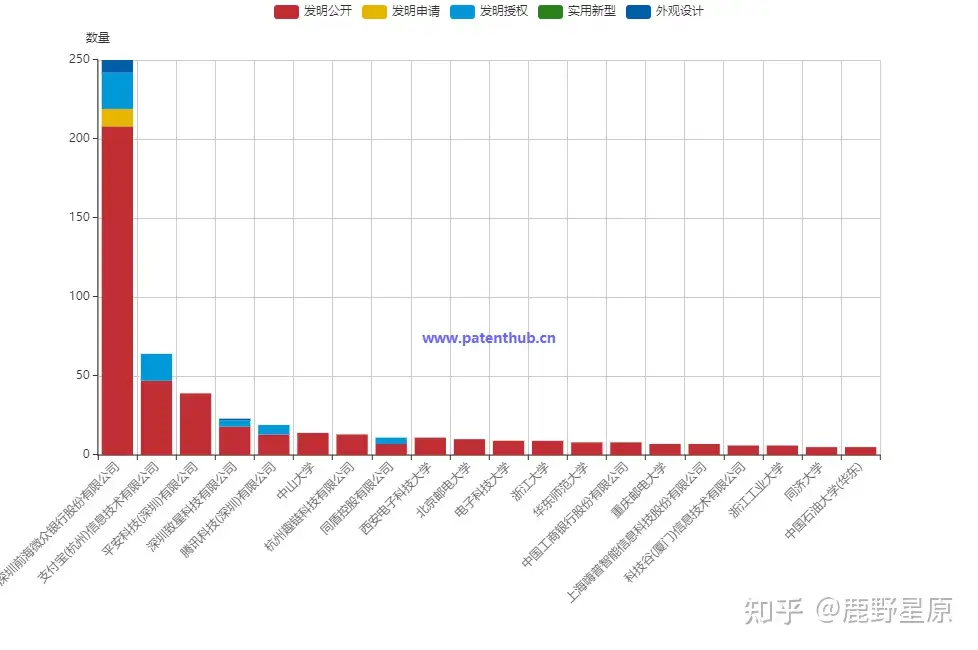

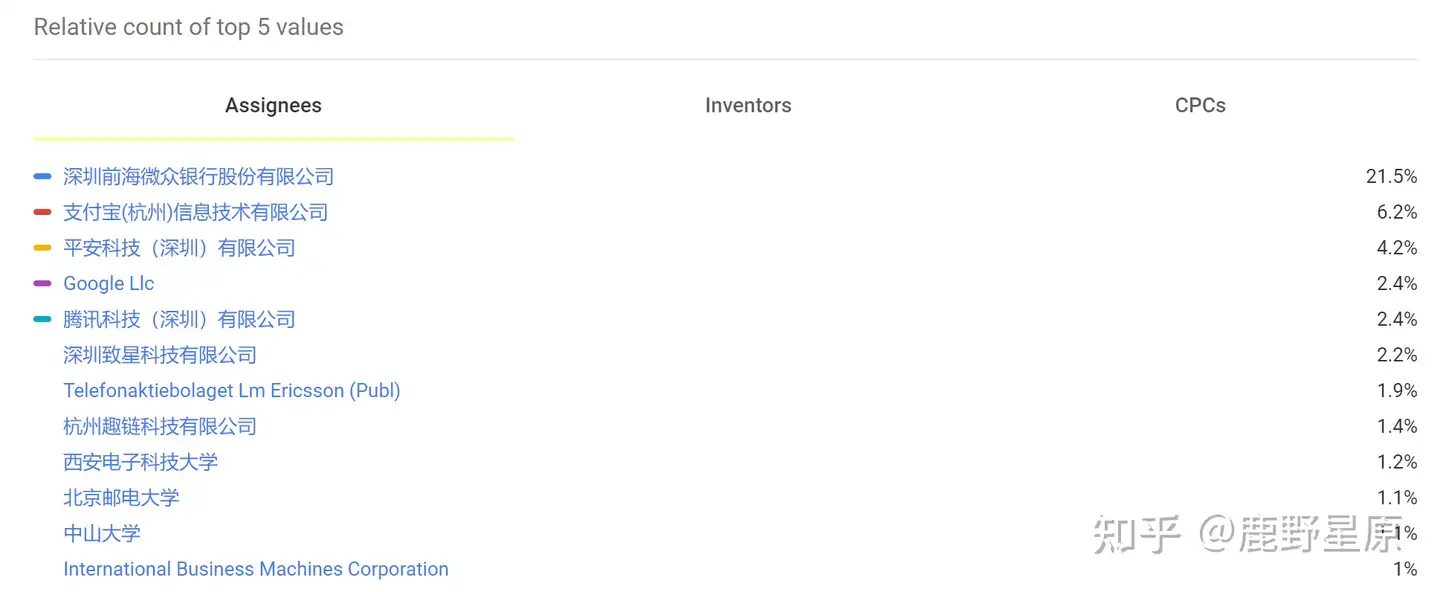

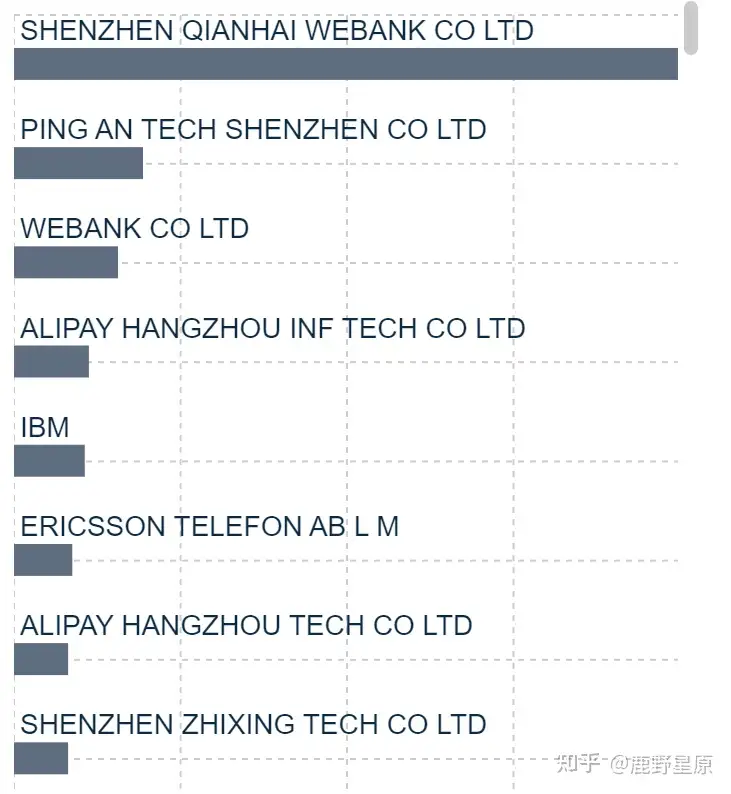

通过专利汇搜索“全球”“联邦学习”相关专利持有情况,申请人和时间分布图如下:

在Google Patents系统中搜索“Federated Learning”,专利持有公司分布如下:

在Espacenet系统中选择“Title, abstract or claims”输入“Federated Learning”,专利申请人分布如下:

可以发现,申请联邦学习相关专利数量最多的是微众银行,申请和授权数量的总和达到200+,支付宝,平安科技、IBM、谷歌紧随其后。

微众银行的金融科技布局

微众银行自诞生之日起就锚定“普惠金融”这一目标,坚持运用人工智能、大数据、云计算、区块链等前沿技术,以进一步提升数字金融服务大众和小微企业的质效。将普惠金融从纸面目标变成实际的服务,科技手段所发挥的作用不可代替:提升用户体验、优化风控水平、扩宽服务范围、降低服务成本等。参见:微众银行的普惠金融AI全布局

在微众银行2019年的全部公开专利申请中,80%以上来自于“ABCD” (AI人工智能、Blockchain区块链、Cloud Computing云计算、Big Data大数据)四大领域。

在人工智能领域,微众银行正在从联邦学习、新一代人机交互、精准营销、智能资管发力,构建以人工智能驱动的金融业务生态,其专利主要覆盖方向包括联邦学习(41%)、NLP/智能语音(16%)、机器学习(10%)、广告/推荐技术(9%)、计算机视觉(7%)等等。

此外,从快速增长的银行专利申请量来看,全球银行业都在不断加速金融科技研发,加强知识产权与技术标准布局,提升创新能力,从而应对数字化转型的挑战。

支付宝的“共享智能”技术

尽管业界已经有联邦学习、拆分学习等多种数据处理相关技术,但单一的技术已无法满足蚂蚁金服及行业内的业务需求,因此针对联邦学习的弊端,在联邦学习基础上研发了“共享智能”技术,并申请了大量专利。

金融业务的数据隐私及安全性要求高。现有的一些方法,如联邦学习,都不属于可证安全的方案。目前已有研究表明,在联邦学习方法中,梯度信息的泄露已经可以反推出部分数据,而特征垂直切分下的拆分学习需要将标签信息传给第三方服务器,也会带来数据泄露或滥用的风险。

数据量大。已有可证安全的技术方案如隐私保护机器学习,由于涉及太多密码学技术,无法适用于大规模的数据场景中。而可信计算技术由于目前的内存限制,也很难直接适用于大规模数据场景中,需要对方案进行改进。

为此,蚂蚁金服提出了共享智能。共享智能融合了现有的隐私保护机器学习、拆分学习和安全计算等技术,结合TEE和MPC两种数据共享路线,用于解决不同业务场景中所面临的隐私保护问题。

IBM的“融合AI”概念和To B模式

IBM的研究人员认为面对多种数据分散分布的场景,发展融合AI与联邦学习的重要性和紧迫性日益凸显。融合AI是让多个模型在广泛分布的数据集上进行训练,并融合这些模型以产生与集中训练相当的效果。

IBM 联合学习侧重于企业用例,联合学习过程的参与方通常是数据中心、来自不同提供商的云实例,以提供一种适用于企业网络和安全要求的架构。

谷歌:更智能的云端机器学习

谷歌主要将联邦学习技术运用于To C方向,想通过联合学习,产生更智能的模型、更低的延迟和更低的功耗,同时确保用户隐私。致力于根据用户使用手机的方式提供个性化的体验。

但在联邦学习环境中,数据以极不均衡的方式分布在数百万台设备上,具有明显更高的延迟、更低的吞吐量连接,并且只能间歇性地用于训练。由此激发了谷歌的联合平均算法(Federated Averaging algorithm),可以使用少 10-100 倍的通信来训练深度网络。关键思想是在现代移动设备中使用强大的处理器来计算更高质量的更新,而不是简单的梯度步骤。

但目前,联邦科技的大部分专利都处于发明公开阶段:比如微众银行有208件专利处于发明公开的状态,11件专利处于发明申请的状态,只有23件专利已经获得授权;支付宝公司有47件专利处于发明公开,17件获得授权。

从申请时间上来看,联邦学习相关专利申请肇始于2017年,2018年开始攀升,在2020年达到高峰,发明公开达到478件、发明授权达到47件。

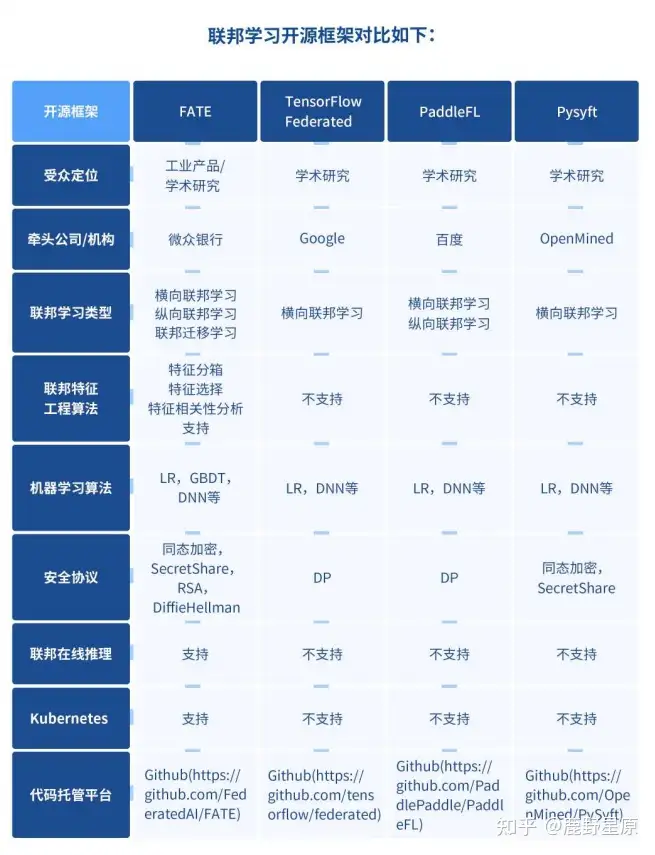

2. 联邦学习开源框架

联邦学习目前主要通过开源框架的方式在市场上开展,主要有微众银行的FATE、谷歌的TFF、百度的PaddleFL、OpenMind的Pysyft,字节的Fedleaner等。

参见:联邦学习白皮书

FATE(微众银行)

采用的是Apache License 2.0许可协议 参见FederatedAI/FATE

FATE提供算法级API的详细安装使用文档,供用户直接使用。 它提供了一个安全的计算框架来支持各种机器学习算法,如 linear regression, logistic regression, boosting tree, NN等,支持异构和同构。

FATE还提供各种模型评估,包括binary classifification, multi-classifification, regression evaluation, and local vs federated comparison。

目前,FATE支持所有三种FL架构,包括纵向FL、横向FL和联邦迁移学习。

此外,FATE 支持单机和集群部署。

TFF(谷歌)

采用的是Apache License 2.0许可协议 参见tensorflow/tensorflow

TFF提供了一个灵活的、开放的框架,可以将本地模拟分散的计算放到所有TensorFlow用户手中。它使开发人员能够在他们的模型和数据上模拟包含的FL算法,以及实验新的算法。TFF还支持非学习计算,比如在多源的数据上进行聚合分析。

TFF提供了两个不同层次的API。联邦学习(FL)API和联邦核心(FC)API。FL API提供了一组高级接口,将现有的Keras或非Keras机器学习模型插入到TFF框架中。FC API自带一套低级接口,是框架的核心,也是构建FL的基础。

通过TFF,开发者可以声明式地表达联合计算,因此可以将其部署到不同的运行时环境中

但是,目前发布的最新版本的TFF只支持横向FL,没有底层的隐私技术(如HE、MPC和DP)来保护数据安全。

TFF只适合实验测试和模拟,无法在真实环境中部署。

而且,TFF只支持单机模拟多机训练模型,而不能支持集群部署。

PaddleFL(百度)

采用的是Apache License 2.0许可协议 参见PaddlePaddle/PaddleFL

主要针对深度学习而设计,提供了计算机视觉、自然语言处理、推荐等领域的多种 FL 策略和应用。

PaddleFL 为研究人员提供了一个基本的编程框架,并封装了一些公共的 FL 数据集,研究人员可以方便地复制和比较不同的 FL 算法。在 PaddlePaddle 丰富的模型库和预训练模型的帮助下,在分布式集群中部署联合学习系统也很容易。

在 PaddleFL 的设计中,它基于 ABY3 实现了安全的训练和推理任务,并使用 DP 作为隐私机制之一。

目前,PaddleFL 支持 Kubernetes 部署,并开源了一个相对完整的横向联邦学习版本,但纵向联邦学习和联合迁移学习仍处于早期阶段。

在横向 FL 策略方面,PaddleFL 实现了多种不同的优化算法,如 DP-SGD、FedAvg 和 Secure Aggregate 等。对于纵向 FL 策略,它提供了两种算法,包括 logistic regression 和 NN。

PySyft (Openmind)

采用的是Apache License 2.0许可协议https://github.com/OpenMined/PySyft-TensorFlow

为 FL 和隐私保护而构建的开源 Python 库,由领先的去中心化人工智能平台之一OpenMined主导。

PySyft能够对深度学习模型进行私有和安全计算。为开发者提供了实现其算法的接口。它将私有数据从模型训练中解耦出来,在不同的深度学习框架(如asiPyTorch、Keras和TensorFlow)中使用FL、安全计算技术(如 MPC 和 HE)和隐私保护技术(如 DP)。

此外,PySyft 还提供了一个全面的分步教程列表,专为初学者设计。这些教程涵盖了如何使用 PySyft 执行 FL、MPC 和 DP 等技术。通过教程,用户可以了解 PySyft 的所有方法,从而为深度学习生态系统带来隐私和去中心化。

Fedleaner(字节)

采用的是Apache License 2.0许可协议 https://github.com/bytedance/fedlearner/blob/master/LICENSE

Fedleaner支持多类联邦学习模式,整个系统包括控制台、训练器、数据处理、数据存储等模块,各模块对称部署在参与联邦的双方的集群上,透过代理互相通信,实现训练。

3. 诉讼情况(非标专利)

联邦学习相关专利(非标准专利)的诉讼方面,在Lex Machina中检索到,主要是IBM就其相关专利向Zillow、Rakuten提起了专利侵权诉讼。

IBM v. Zillow

IBM主张房地产巨头Zillow利用其专利技术构建房屋价值估算和搜索功能。

诉讼中心的七项专利涵盖了各种不同的技术,其中核心专利涉及通过计算机计算能力来分析地理区域的质量和可取性,并以适应用户阅览屏幕的方式呈现搜索结果。

IBM 主张 Zillow 因侵犯其专利技术而获得了数十亿美元收入,要求向其支付许可费、并要求法院颁布禁令。

目前该案还在审理中,法院认为Zillow可以对 IBM 的 389 和 789 专利相关的诉讼请求获得有利判决。

参见:IBM sues Zillow, accuses the real estate giant of building key features using Big Blue’s tech

IBM v. Rakuten

IBM主张乐天侵犯了其电子商务相关专利,认为乐天的网站和移动应用程序使用其专利技术在产品上选择性的提供广告、提供现金返还优惠。

诉讼中心的七项专利主要指向“在交互式服务中展示应用程序和广告的方法”。如,346 专利通过开发在“联合计算环境”内进行系统交互的方法来代表用户触发单点登录操作,从而改进了单点登录技术。

目前该案还在审理中。

参见:IBM Sues Rakuten for Infringement of E-Commerce Patents - Tech